M1 Ultra 能杀死 DSP 吗?

苹果发布会第二天,一早到公司同事 @焦聚 就问我:

“DSP是不是要淘汰了?”

这个问题,每十年都会被翻出来

M1 Ultra 确实强得离谱,Geekbench 多核跑分 24055 已经匹敌 AMD 3990X (现在 Amazon 零售 $8385 美金),因此 Mac Studio 可谓 “买 CPU 送电脑”。

很难想象,如果新款 Mac Pro 整合两块 M1 Ultra 能强到什么程度。

迫于苹果的压力,Intel 和 AMD 必须要挤爆牙膏,预计 CPU 行业能迎来新一轮性能爆发,

这让我们重新思考一个问题 :

如果 CPU 很强很强

DSP 会被淘汰吗?

~————————————~

DSP 几斤几两 ?

~————————————~

录音行业的“标准声卡”厂商人称“4A 公司”,它们目前都带有 DSP 和 (插件级) 效果器,逐个看看。

先是我们评测的 Apollo X 系列,DSP 运算芯片的型号是:

SHARC ADSP-21469

主频 450MHz (留意不是 GHz)

214XX 系列是 2008 年发布的

能查到这是65nm制程

相比目前苹果的 5nm、AMD 的 7nm、Intel 的 10nm,这是将近 20 年的差距..

不过 mouser 现在给 ADSP-21469 (KBCZ4) 的报价还高达 $39 美金/片,Apollo 声卡里有好几片。

相比起 Avid, UA 已经算“先进”

无论 HDX 还是 Carbon 都用的

TI TMS320-C6727

2007 年发布,主频 250MHz..

制程 90nm, 单价$18美刀..

虽然 HDX 有 18 片,Carbon 有 8 片,但这些成本相比整机售价就算根毛.. Avid 卖的是“标准”..

当然业内也有先进的芯片

Antelope 以前打算用纯粹的 FPGA 运算,后来发现还是要加上 DSP,于是又有了“SC”后缀 (代表“协同”) 的声卡,有些效果器走 FPGA,有些走 DSP,这是业内独一家的设计方式。

FPGA 是 Lattice LFE5U85F

400MHz / 40nm / $52 美刀

DSP 是 NXP MIMXRT1052

主频600MHz (ARM M7)

制程算是“先进”:28nm

不过这块 DSP 的零售价仅为 $14 美刀/片...说明售价并不是由制程决定的。

“4A 公司”已经介绍了三个 A,最后一个“A”是我们拆解的 Apogee Desktop,DSP 芯片是:

Intel Cyclone V SE

具体型号:5CSEBA2U19C8N

双核FPGA SoC (ARM A9)

600MHz主频, 28nm制程

这块 FPGA 可以设计成 DSP,价格也是这里最贵的——$69 美金/片,当然 Apogee 也只用了一片..

$69 美金能买到啥 CPU?

查了一下 NewEgg,用 Apogee 那片 DSP 的价格已经能买到散装奔腾 G6400 (2020年上市,14nm 制程)、盒装酷睿 i5-3450 (2012年,22nm) 与盒装赛扬 G555 (2012 年,32nm)

~——————————————~

那为啥不用 CPU ?

~——————————————~

也有人这么干:NI Maschine+

它用了 Intel Atom C3508

$86 美金/片、14nm 制程

之前业内的独立“鼓机工作站”都用 SoC + DSP (或 FPGA) 方案,NI 是首个使用 CPU 级别芯片的鼓机工作站,用来运行宿主工作站和效果器运算。

我没拆过 Maschine, 但我知道

它没有散热孔和风扇

毕竟 C3508 热功耗 12W

对比常规 Intel CPU,这个 TDP 热功耗已经非常低,上文 $69 美金的 Intel G6400 有 58W、i5-3450 是 77W、赛扬 G555 是 65W。

留意 TDP“热功耗”不是“实际功耗”,实际功耗会更高。

对比 DSP,CPU 的功耗是不可接受的:ADSP-21469 最高功耗 1W/片,Cyclone V 是双核 1.8W,

如果声卡和效果器用上 CPU..

可能需要巨大的风扇..

UA 的用户应该知道,Apollo 声卡虽然全是散热孔,但发热也是惊人的,Apogee Desktop 会好一点,因此官方没加入散热孔,但发热也远高于常规声卡。

个别的机架声卡里确实有风扇

例如 Pro Tools Carbon

目前在售带风扇的声卡,行业里据我所知就只有两三个,而且都是机架式设计。

CPU 的效率也经常被吐槽 :

“一核干活, 多核围观”

这是十几年的老论据,DSP 虽然只有几百 MHz,但全部用来处理音频,效率 100%。虽然 CPU 多核效率已有所提升,但 M1 的效率优势是“能效”(发热低),如果比“多核效率”,按 Geekbench 算一下只有 70%,与同样核心数的 Intel 酷睿持平,低于 Intel 至强的 80% ~

“多核优化”是个系统工程

还取决于操作系统、DAW 和插件

任何一环没做好都影响整体

对比 Logic Pro 和 Studio One 的资源占用情况,很明显 Logic Pro 优化更好,充分利用了 M1 的性能核心,而 Studio One 只能和 macOS 系统一起抢夺效率核心,多核优化最差的是 Avid,想用 Pro Tools 你只能上更贵的电脑..

留意 Studio One 5.5 已经是“原生”支持 M1 的版本

另外如果音频设备要上 CPU,大概率还要搭配 Windows CE 或者 XP 系统,这也有风险,

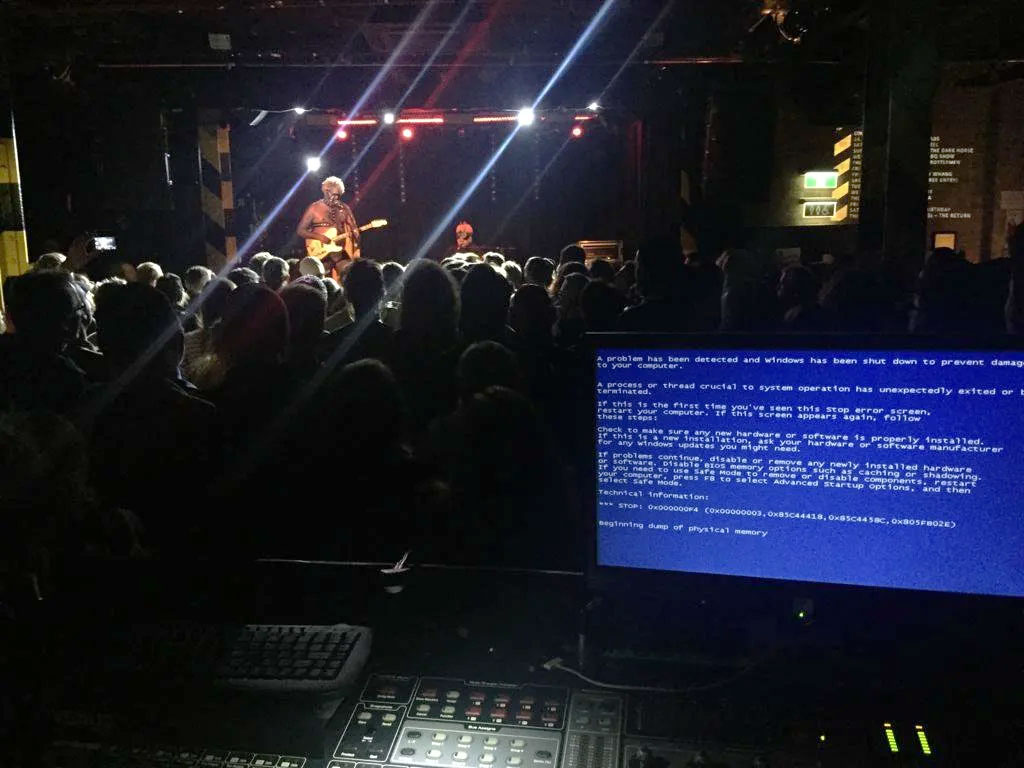

下图是某个用 CPU 的现场台子

价格好几十万, 就不点名了

真的会遇到“蓝屏”..

~————————~

其他原因

~————————~

篇幅有限,不能列出所有原因

还有一大原因是现场演出

演出时总不能打开一台电脑 ..

因此音乐人还需要独立的吉他效果器、独立的鼓机、独立的 DJ 台子、甚至独立的人声效果器..

事实上苹果发布 Mac Studio 时

就用了硬件的 DSP 效果器

而且还用了两台, 都是经典

一台 TC Fireworx, 一台 M3000

这又涉及到更多原因:

效果的算法/专利/品牌/传承

尤其是 TC 最值钱的“行业标准”混响算法,不是你可以随便用的,其实 Antelope 声卡当时升级到“SC”也是为了加入 Autotune 插件,这个效果应该只能用在 DSP 上。

我个人看法是:

DSP 永远不会消失

就像自行车不会被电动车取代

就像摇头电扇不会被空调取代

它原始落后、但方便高效

熟悉数码相机的朋友知道,SONY 今年发布的 A7M4,CMOS 和处理芯片都是 40nm 制程。

DSP 芯片的一些新进展

DSP 虽然发展缓慢,但也有进步,像 SHARC 已经升级到“SHARC+”的 ADSP 215xx,制程从 65nm 升级到 40nm,性能接近目前 21469 的两倍,主频可触达 1GHz;而最新的 Intel Cyclone 10 已经是 20nm 制程 (很贵,超过 $100 美金)..

根据芯片行业的共识,“缺芯”的问题可能在 2023 年解决,我猜今年 DSP 声卡厂商们可能都无法升级,明年倒是有可能。