机器人会抢音乐人的饭碗吗?

最近去电影院,惊觉售票处一个人都没有,只有几台阿里“淘票票”自动售票机,买票效率确实提高不少,但售票员(尤其美女)失业了!小编刚来北京时,地铁还有大妈坐在入口收票,后来大妈变成了炸鸡...不,闸机...这只是简单的自动化,谈到现在火爆的“人工智能”,李开复老师认为15年后 50% 的职位会被部分、或全部取代。

技术在让所有人受益的时候,也让一部分人失业

和其他行业的精英一样,很多音乐人觉得:写歌不是卖票!想想,李世石老师是不是也这么想过——下围棋又不是卖票!最新消息是,AlphaGo 升级版的 Master 已经击败了围棋界现役 No.1 的柯洁(目前全球 No.1)。

软件曾让一些音乐人失业,30年前棚里还有“音准师”一职,专门监督歌手音准,后来 “Autotune”纠调软件出现了... 靠绝对音高吃饭的还有钢琴调音师,随着数码钢琴崛起,原声钢琴销量已经跌倒十年前一半,而数码钢琴不需要调音。

这种淘汰如此自然,你以为刚开始,就结束了

还有哪些音乐人会被取代?

今天我们从音乐的流程逐个分析下,

词 / 曲 / 编 / 弹 / 唱 / 录 / 混 / 母

看本文的还有一种人:老板,希望用最低成本获取最高效率。就像一百年前酒吧老板们想用一个鼓手取代四五个鼓手,这就有了架子鼓,他们可能和音乐人的视角完全相反。

——————————

智能母带

——————————

音乐制作流程的最后工序,“母带/Mastering”原本是为实现专辑的“音量均等化”,毕竟专辑里不同歌曲可能由不同的录音师负责,后来“响度战争/Loudness War”爆发,母带流程变成“最大不失真”处理。好莱坞近年均价在一万美刀/专辑、或 $1000 美刀/单曲(专辑的活越来越少),不过小编最近有朋友找国际一线的母带师合作,价格只有 $500/单曲。

LANDR 是一个在线的人工智能程序,历经八年研发在 2014 年上线,上传歌曲它便能分析歌曲类型、然后根据“深度学习/Deep Learning ”进行一堆 EQ/压缩/音量处理,而且几乎是实时处理——人类母带师干活就要等几天了。

全球最大声音互动平台 SoundCloud 整合了 LANDR,最新版 Sonar 也整合了 LANDR,LANDR 还跟虾米达成了合作,应用场景已经非常广泛成熟,如果你觉得“活人母带师”的报价有点高,可以试试 LANDR:

www.landr.com

2016年,LANDR 迎来了首个对手,由格莱美级录音师 Smith Carlson 和知名制作人 Collin McLoughlin 打造的 eMastered,流程都是上传/分析/处理,但价格有优势:无损档 $15 美刀/月,比 LANDR 便宜 $10 美刀。

不过人工智能的“深度学习”需要积累(就像 Alphago 学了 16 万局旗才打败李世石),目前 LANDR 在学习上至少还有两年时间、几十万首歌的学习积累。

https://emastered.com

在文章即将写完之际,又出现了一个好玩的,

有点像去年风靡全球的 Prisma 图像学习 APP

你先上传自己的歌,再输入你想参考风格的歌

你的歌就变成那首参考曲的母带风格了

https://sound.tools

————————————

智能录/混音

————————————

其实国内常叫的“录音师”是指混音师...“录音”的具体操作其实只有两个:按下录音键、和调节 Gain/增益,后者早已实现自动化,例如 Roland 声卡的 Auto-Sens,话放检测到过载 3dB,增益就衰减 3dB,确保你得到不“冒红”的最大音量。

不过难度都在按下录音键之前,例如根据你的嗓音挑选话筒/话放、并将话筒摆到最好的位置,最关键的还有歌手的情绪调整和反馈,这都不是“人工智能”可以干的,得有活人,所以高水准的“录音”都是制作人亲自担当,短时间不会被取代,

但“智能混音”有点进展

简单来说,混音就是音轨管理,一首流行歌在编曲后可能有五六十条音轨,混音基本工作是确保声部主次(Volume)、频率(EQ)、空间(Pan 和混响)方面不让音轨“打架”,然后通过压缩、延迟、失真等效果器美化音轨。根据最新的行情,国际一线混音师收费在 $2000 美刀/单曲,中国的一线混音师大概在 $1000/单曲(大概六七千块钱一首)。

从价格来看“混音”比母带处理更复杂,人工智能目前无法干全部混音,但是能做一部分,那就是智能插件,今年最受关注——已实现量产的是一款“智能通道条”:

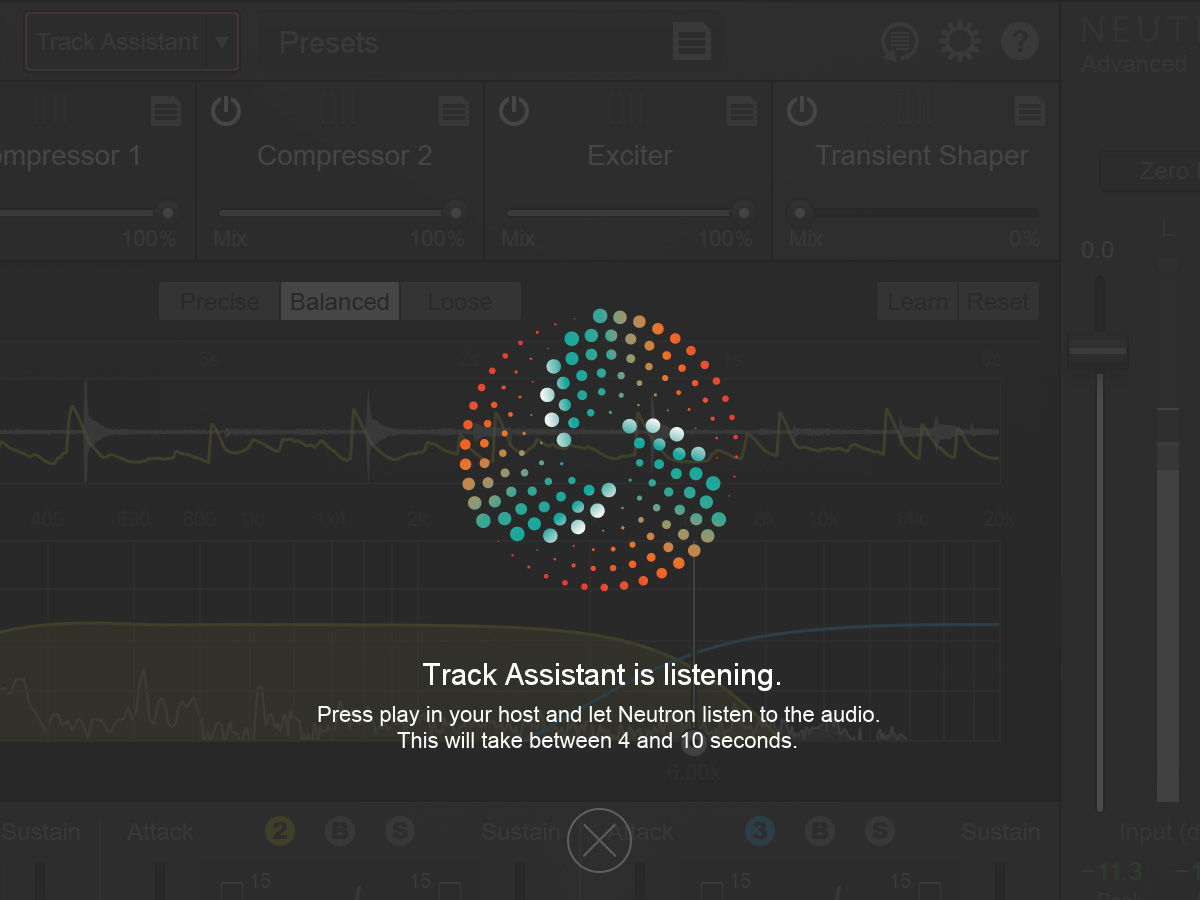

iZotope Neutron

https://izotope.com/en/products/mix/neutron.html

看上去与普通的数字通道条并无二样,带有五个效果器:八段 EQ、压缩、激励、瞬态整形和压限。不同之处只是多了一个按钮,叫“Track Assistant/音轨助理”,听起来和“辅助驾驶”很像,只要点击这个按钮,系统就开始分析音轨,

分析过程需要 4 秒 ~ 10 秒,然后...

五个效果器的参数就帮你设置好了

比起单轨,Neutron 更适合用在 BUS 分组母线,例如让“人声组”的 EQ 不打架、或者让 “鼓组”得到最合适的压缩,Neutron 可以设置四档处理强度,在自动设置完成后,每一项参数你都可以自己继续微调。

你会说:这只是混音的一部分而已。混音分为“解决问题”和“美化”两部分,“美化”很大部分是由编曲人负责的,而“解决问题”,能大大降低混音的难度,我想一、二线混音师暂时不用担心,但三四线混音师可能会被迫降价或者改行。

其实国外有不少大学和声音研究所正在研发智能混音(包括国内的团队),不过 iZotope Neutron 是首个实现量产的,从研发到量产,硅谷的时间概念通常是五年。

继续往下,“智能”的难度越来越高

——————————————

智能编辑/编曲

——————————————

先定义一下这两个概念,“编曲”是有歌手给你个自弹自唱的 Demo/小样,你要给这条音轨添加几十甚至上百轨,变成一首完整的歌曲;而“编辑”是将录好的音频进一步编辑,弥补或美化每一条音轨,而复杂的编辑也算得上一部分编曲和一部分混音。

除了“编曲型编辑”和“混音型编辑”,普通编辑早已通过插件实现部分自动化,不用手动改每个音,底噪大可以降噪、DeEsser 可以降齿音、Autotune 纠音准(甚至用 Melodyne 纠和声歌手的音准)...虽然目前没有整合方案,但“Neutron 们”迟早会整合这些插件~

DAW 们自己也整合了部分自动编辑,有些是插件很难做到的,例如 “音频量化”、自动淡入/淡出等,去年开始部分 DAW 开始加入“单轨编辑窗”,DAW 们的单轨编辑能力会在近两年有较大的进展(并且导致插件商的日子更难过...)。

编曲方面,之前有不少“自动编曲”的单机软件,如 HarmonyBuilder,问题有两点:一是只能根据原厂程序进行编曲,细致程度谈不上“专业”、没有创造力也谈不上“智能”;

二是与无法与 DAW 宿主软件整合

这意味着无法利用大量的音色、虚拟乐器和效果器,也很难进行后续的混音。不过新生代智能编曲软件正在路上,有些还处于研发阶段,例如 JukeDeck(jukedeck.com),实现量产的并不多,例如来自洛杉矶 Re-compose 公司的:

Liquid Notes

首先它能与 DAW 宿主整合,支持 Cubase、Logic、Pro Tools、Sonar 和第三方音色插件... 你需要导一段 MIDI 给它先进行分析,它能分辨出打击乐、Bass 或旋律,然后分析和弦并生成每一轨的复杂旋律,最后将其 MIDI 输出对应 DAW 的 MIDI 输入就可以了。

Liquid Notes 的缺点是需要给它“喂”分轨(它只是将分轨变得更复杂),也就是说要进行简单的“预编”;另外 Liquid Note 还有一个“Live”版本,能根据你的已有旋律进行实时演奏,相当于一个即兴乐手。

很多人忽视了苹果公司 Garageband 的 Drummer,这个鼓手插件有最好的“辅助编曲”方式,你只需选择鼓手,然后实时设置每个鼓件音符的多少、音色强弱、“Fills/加花”的多少和 Swing/人性化,即使是小白,也能瞬间做出一条专业的鼓轨。

——————————————

机器弹奏

——————————————

即使 AlphaGo 升级版的 Master 已称霸人类围棋界

“它”依然还没学会走路

先不说保持平衡能力(全路况),即使是能保持平衡的汽车,“自动驾驶”能力在 2017年初也只能达到第二级(叫“辅助驾驶”),还要跨越第三、四级,才能到第五级的“完全无人驾驶”,因此——运动能力是对机器人很大的考验。

不过依然有工程师希望挑战一下,分别是:

来自日本的 Z Machines 乐队

名字致敬了研发“人造太阳”的美国 Z Machine

还有来自德国的 Compressorhead

http://compressorhead.rocks

来段视频:音符多但没有轻重,并不像人类演奏

尽管现在看起来机器人还有点违和感

不过是否比猴子弹吉他要利落点?

——————————————

智能主唱

——————————————

上面两个机器人乐队都没有主唱,这可能真有点难

唱跳/表情先不考虑,光谈声音,去年也真有突破

很多音乐人熟悉 YAMAHA 的 Vocaloid/初音未来,可以设置歌词和音高生成人声旋律,目前的缺陷主要是:音色固定,你要“购买歌手”;二是听起来还不够自然(或者需要复杂的“气口”设置),它只是个人声合成软件,与智能没有什么关系。

但现在语音也可以“学习”了

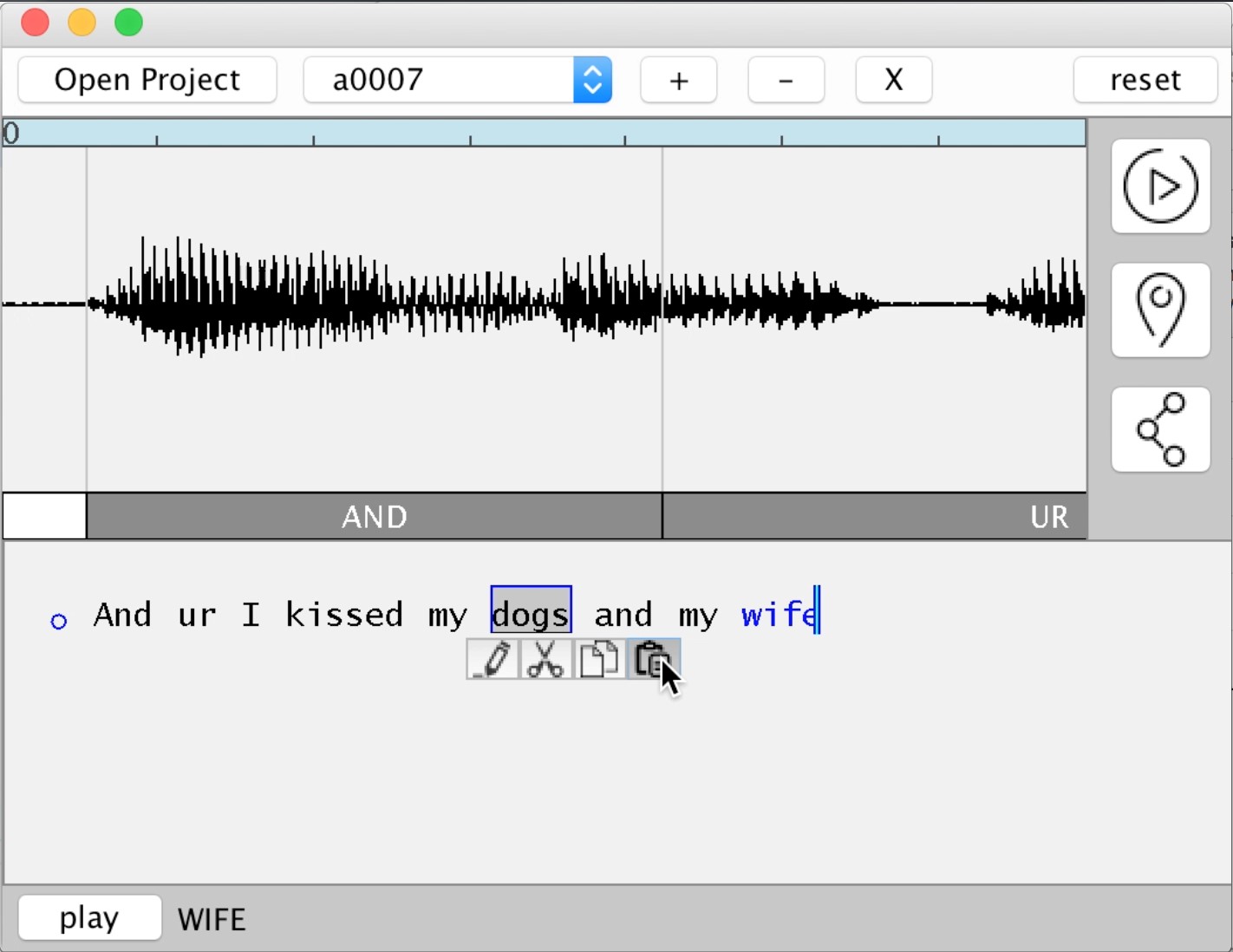

Adobe VoCo

目前还没有量产,Adobe 只是演示了一下,用于电影配音,以前不小心配错了需要重录,但现在 Voco 可以“学习”人的音色,然后只需修改文字,全新的语音就合成出来了。

音色逼真得 360°无死角

(百度最近也合成了个张国荣,但不够逼真)

一旦 Voco 量产上市,搭配音高软件来唱歌没有问题,如果处理速度能够达到实时,那就会有点恐怖——你可以模仿任何人说话与唱歌,例如让 Voco “学习”你爸的音色,然后假装给班主任打电话... 再例如学习周杰伦的音色,

无论你是谁,一开口就可以是周杰伦

(以后歌手得有音色版权,不能随便使用)

以下流程貌似不用依赖 DAW

——————————————

智能作词/作曲

——————————————

作为音乐的源头,词/曲创作是最难的

歌词是接近诗歌的一种文学,不过文学的一种形式已经有机器人出没:新闻。有人把2016年称为“新闻机器人元年”,目前我们所看的新闻已经有 6% “不是人写的”,因此歌词中最接近新闻形式(字数多、直白)的一个分类也有机器人出没:

“说唱歌词生成 AI”

http://deepbeat.org

免费在线使用(但生成歌词要等),这个机器人学习了大量的英语说唱歌词,以此给你生成新的歌词,你还可以选择在歌词中加入“Love”、“Truth”、“Birthday”等常用词汇,官网上大家也能看到不少说唱歌手正在使用,官方还公布了论文给同行们研究。

可预料“摇滚歌词 AI”和“流行歌词 AI”会陆续出现(但“民谣歌词 AI”有点难,Bob Dylan 去年又拉高了民谣歌词的门槛),不过还有个最大问题:

音乐无国界但语言有门槛

欧美的英语歌词 AI 对于其他语言国家作用不大(不可能用 Google 翻译吧),另外东方的文字/语言由于发展时间太久,也更加复杂隐晦,也许还要屏蔽很多敏感词并且押韵...

智能作曲方面,去年有个较大的新闻

来自 SONY“电脑科学实验室”研发的

Flow Machines

一开始它学习的是巴赫,貌似很轻松...

因此我们现在能听到巴赫的“新歌”了

然后它又学习了不同的风格,包括美国淘金时代的老歌、60年代的披头士...同时能力也不停提高,现在“Machines”包括四个机器人:智能作曲、智能编曲、智能乐手、智能巴赫。实验室在2017元旦给 Flow Machine 开了个音乐会,今年还打算出专辑...

下面这首号称是全球第一首 AI 歌曲:

“学习”披头士风格的《Daddy's Car》

(歌词是乱来的...只有语音但缺乏歌词能力)

去年亦庄工商局一位科长来叉烧网考察,刚好是音乐爱好者,就顺便咨询我们——他特别喜欢邓丽君,歌曲已经听得滚瓜烂熟,但他希望邓丽君还活着,能带给他新歌。虽然有代沟,不过小编也多么希望 Michael Jackson 也活着,并带给我们新歌...

现在我感到 “虚拟邓丽君”、“虚拟张国荣”、“虚拟 Michael Jackson” 并非不可能。

——————————————

结语: 虚拟歌手

——————————————

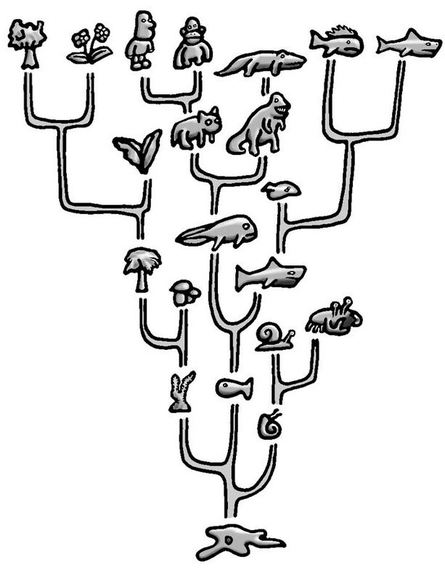

人类的基因有 50% 与香蕉重合

是的,我们与香蕉有同一个祖先。氨基酸进化为单细胞动物、再到多细胞动物,然后一个分支进化为植物,一个分支进化为动物,我们没有必要、也不可能消灭植物,所以小编并不认为人类会被机器人消灭,电影的目的只是让你买票而已。

在可见的未来里,各行业的智能机器人(或程序)会涌现,它们拥有不同的功能、受人类的控制、并且在某个领域为人类服务,对于音乐行业,

最先出现的会是各种“虚拟音乐人”

“虚拟母带师”已经比较成熟,目前有四五位,以后还有更多,然后是虚拟混音师、虚拟编曲师、虚拟键盘手、虚拟吉他手、以及虚拟歌手/乐队。

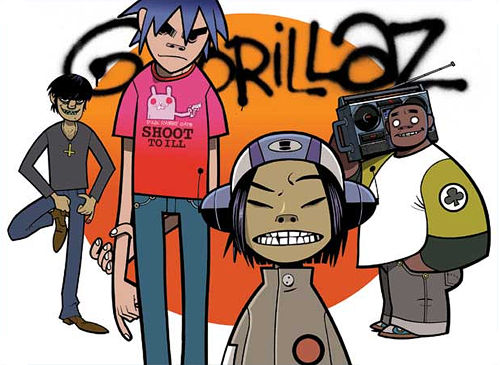

不同于受人控制的 Gorillaz(下图,1998年发布)和初音未来(2003年发布)的是,新一代虚拟歌手会拥有“学习能力”,虽然意味着无限的作品创作能力,但一首歌能不能火,并不取决于作品,而是关系到推广能力,“网络神曲”火爆并不是因为它们旋律优美、歌词深刻或者制作精良。

这会导致一部分音乐人失业

就像百年前的人力车夫、20年前的打字员

但他们失业是因为: 我们变成了他们

现在每个人都能自己开车、每人都能打字

因此一部分音乐人会很兴奋

以前和现在,他们的能力和视野都有局限

吉他手不会弹钢琴、鼓手不会拉小提琴、

玩摇滚的不懂古典、玩民乐的不懂说唱、

玩制作的不懂现场、扩声的不懂电影配乐

你的创作状态不会始终饱满,灵感会枯竭

但通过与虚拟音乐人合作,你将变得全能

你可以雇佣“虚拟张亚东”、

并且与“虚拟高晓松”和“虚拟金少刚”合作

虚拟音乐人不用睡觉、同时能接待几百人

而且成本更低、省心、并且实时得到结果

那张亚东老师岂不是失业了吗?不,

他会与虚拟电影人合作,成为“虚拟黑泽明”

每个人都可以跨界,作品只局限于你的创意

1917年,我们没有工业污染、没有工作压力,也没有战争,但人均寿命只有35岁(这么算小编已接近死亡)。你不会想回到100年前、不会想回到刚解放时(人均寿命还是35),你甚至不想回到1997年,没有手机、没有外卖、交通工具以自行车为主。

20年后,你也不想回到2017年

小编正前往 NAMM Show 乐展,有最新动向马上更新